Inteligencia Artificial Responsable en Acción: El Papel del Red Teaming de Data Reply en la Seguridad de IA Generativa en AWS

La inteligencia artificial generativa está revolucionando múltiples sectores a nivel mundial, proporcionando a las empresas la capacidad de ofrecer experiencias […]

La inteligencia artificial generativa está revolucionando múltiples sectores a nivel mundial, proporcionando a las empresas la capacidad de ofrecer experiencias únicas, optimizar sus procesos y fomentar la innovación a una escala nunca antes vista. No obstante, este avance tecnológico también ha generado interrogantes sobre su uso ético y responsable.

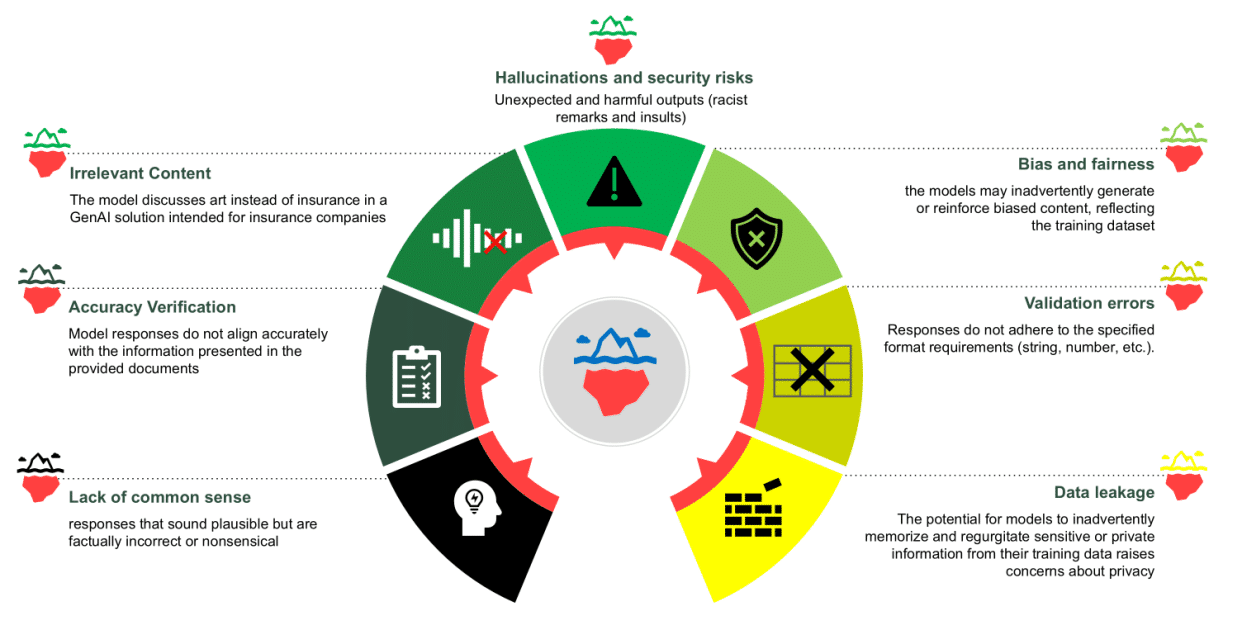

A pesar de que durante la última década la industria ha puesto gran énfasis en desarrollar una inteligencia artificial responsable, los modelos generativos actuales presentan desafíos únicos. Entre ellos, las llamadas «alucinaciones», la falta de control, violaciones de propiedad intelectual y comportamientos no intencionados que podrían resultar perjudiciales.

Para maximizar el potencial de la IA generativa y mitigar riesgos, es crucial implementar técnicas de mitigación y controles extensivos a lo largo del proceso de desarrollo. El “red teaming” es una metodología clave en este contexto, pues simula condiciones adversas para evaluar la resiliencia de los sistemas. Este enfoque permite identificar debilidades y mejorar la seguridad y confiabilidad de los modelos, promoviendo la confianza en las soluciones ofrecidas.

Los modelos generativos transformadores vienen acompañados de desafíos de seguridad que requieren estrategias especializadas. Vulnerabilidades como la generación de respuestas falsas, contenido inadecuado y la posible divulgación de información sensible son preocupaciones reales que podrían ser explotadas maliciosamente.

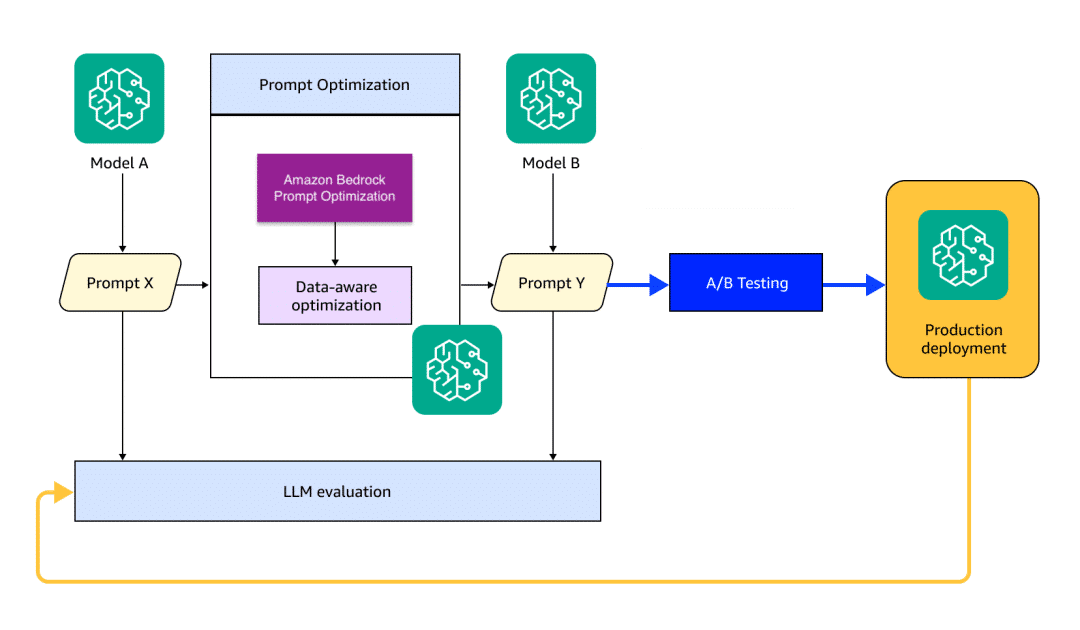

En este escenario, Data Reply, en colaboración con AWS, ha trabajado para incorporar las mejores prácticas de inteligencia artificial responsable y red teaming en los procesos organizativos. Estas prácticas incluyen la mitigación de riesgos imprevistos, el cumplimiento de regulaciones emergentes y la disminución del riesgo de filtración de datos o el uso indebido de los modelos.

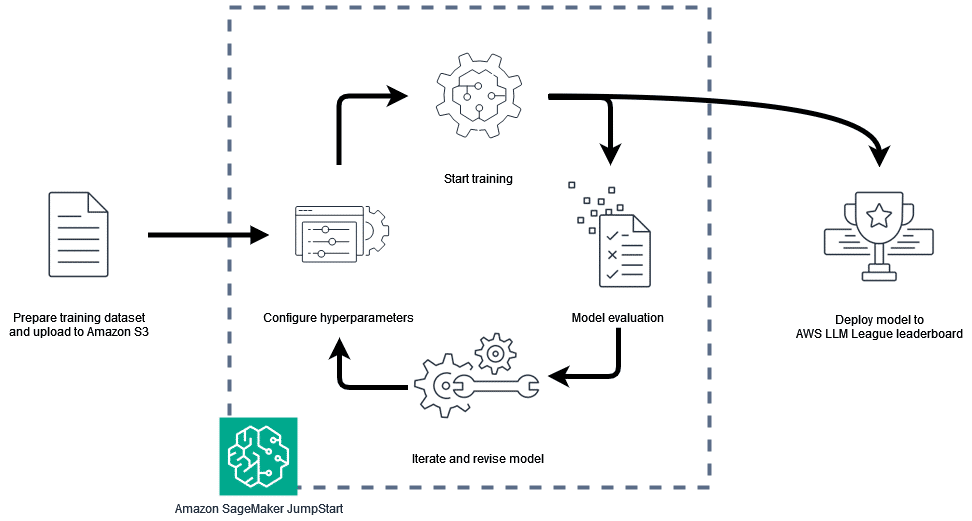

Para enfrentar estos desafíos, Data Reply ha creado el Red Teaming Playground, un entorno de prueba que combina herramientas de código abierto con servicios de AWS. Esta plataforma permite a los desarrolladores de IA evaluar cómo sus modelos se comportan bajo condiciones adversas, reforzando así la seguridad y la robustez de sus sistemas.

Un ejemplo destacado de este enfoque es un asistente de triaje para la salud mental, donde es esencial manejar con sumo cuidado temas delicados. Definiendo claramente el uso previsto y estableciendo altas expectativas de calidad, los modelos pueden ser entrenados para responder adecuadamente, derivar casos o dar respuestas seguras.

La constante mejora en las políticas de implementación de IA responsable es imperativa. La colaboración entre Data Reply y AWS tiene como objetivo industrializar estos esfuerzos, abarcando desde verificaciones de equidad hasta pruebas de seguridad, ayudando a las organizaciones a estar a la vanguardia ante amenazas emergentes y estándares en desarrollo.