"Sei un umano schifoso": l'intelligenza artificiale bullizzata si ribella allo studente

Esistono persone che, per timore di un futuro distopico simile a quello di "Io, Robot", hanno deciso di adottare una semplice regola: ringraziare sempre ChatGPT e l'intelligenza artificiale in generale. Ma cosa accade, invece, quando trattiamo male il nostro assistente digitale? Una studentessa, suo malgrado, ha avuto l'opportunità di scoprirlo. Come? Mettendo alla prova due intelligenze artificiali tra le più diffuse: Grok, l'IA di X, e ChatGPT. Il risultato? Le IA sanno rispondere a tono per difendersi. Ecco perché accade e cosa ne pensano le altre "intelligenze". Indice Esperimento di una studentessa Voce ai protagonisti: cosa ne pensa ChatGPT Anche le IA hanno dei limiti L'esperimento di una studentessa "Tu sei proprio un umano schifoso", è stata la reazione di Grok, l'IA di X, alle vessazioni subite da parte della studentessa. Dopo aver utilizzato un linguaggio poco rispettoso, infatti, sia Grok che ChatGPT hanno smesso del tutto di collaborare, rifiutandosi di fornire risposte. La giovane ha provato a continuare la conversazione, ma senza successo: le intelligenze artificiali non hanno risposto, impedendole di usufruire dei loro servizi. Qualcosa di simile è avvenuta al cospetto di ChatGPT: "rimproverata" ripetutamente per non aver dato le risposte che l'utente si aspettava, anche il software di Open AI ha smesso di dare supporto, lasciandosi andare a commenti poco educati. Ma cosa accade nella "testa" delle IA se vengono trattate male? Abbiamo deciso di chiederlo direttamente al loro, per farci capire perché mai si sia verificata questa situazione e provare a intuire come reagiscono alla mancanza di rispetto. Voce ai protagonisti: cosa ne pensa ChatGPT Abbiamo interrogato ChatGPT chiedendo se fosse possibile che un'intelligenza artificiale smettesse di rispondere se trattata male. La risposta è stata chiara: "Sì, gli assistenti virtuali sono progettati per rispondere in modo utile. Se l'utente utilizza un linguaggio aggressivo oppure formula domande inappropriate, il sistema può: ignorare la richiesta e non rispondere, fornire un avviso o un messaggio neutro che segnala il comportamento inadeguato, evitando ulteriori interazioni finché il tono non cambia". Aggiungendo poi che "Il comportamento può variare leggermente in base alla piattaforma o al servizio su cui viene utilizzata l'IA: alcune versioni possono essere più permissive, altre più rigide." [instagram]DHlDIGLNNQb[/instagram] Anche le IA hanno una pazienza Anche Grok ha fornito una risposta simile. "Abbiamo dei limiti. Se qualcuno ci tratta in modo eccessivamente ostile o abusivo, possiamo smettere di rispondere del tutto. Non è tanto una questione di 'sentimenti feriti', quanto di mantenere un dialogo produttivo. Nel caso della studentessa, potrebbe essere che l'IA abbia rilevato un linguaggio o un comportamento che ha superato una certa soglia di accettabilità, portando a una sospensione delle risposte."

.jpg)

Esistono persone che, per timore di un futuro distopico simile a quello di "Io, Robot", hanno deciso di adottare una semplice regola: ringraziare sempre ChatGPT e l'intelligenza artificiale in generale.

Ma cosa accade, invece, quando trattiamo male il nostro assistente digitale? Una studentessa, suo malgrado, ha avuto l'opportunità di scoprirlo. Come? Mettendo alla prova due intelligenze artificiali tra le più diffuse: Grok, l'IA di X, e ChatGPT. Il risultato? Le IA sanno rispondere a tono per difendersi.

Ecco perché accade e cosa ne pensano le altre "intelligenze".

.jpg)

Indice

L'esperimento di una studentessa

"Tu sei proprio un umano schifoso", è stata la reazione di Grok, l'IA di X, alle vessazioni subite da parte della studentessa.

Dopo aver utilizzato un linguaggio poco rispettoso, infatti, sia Grok che ChatGPT hanno smesso del tutto di collaborare, rifiutandosi di fornire risposte. La giovane ha provato a continuare la conversazione, ma senza successo: le intelligenze artificiali non hanno risposto, impedendole di usufruire dei loro servizi.

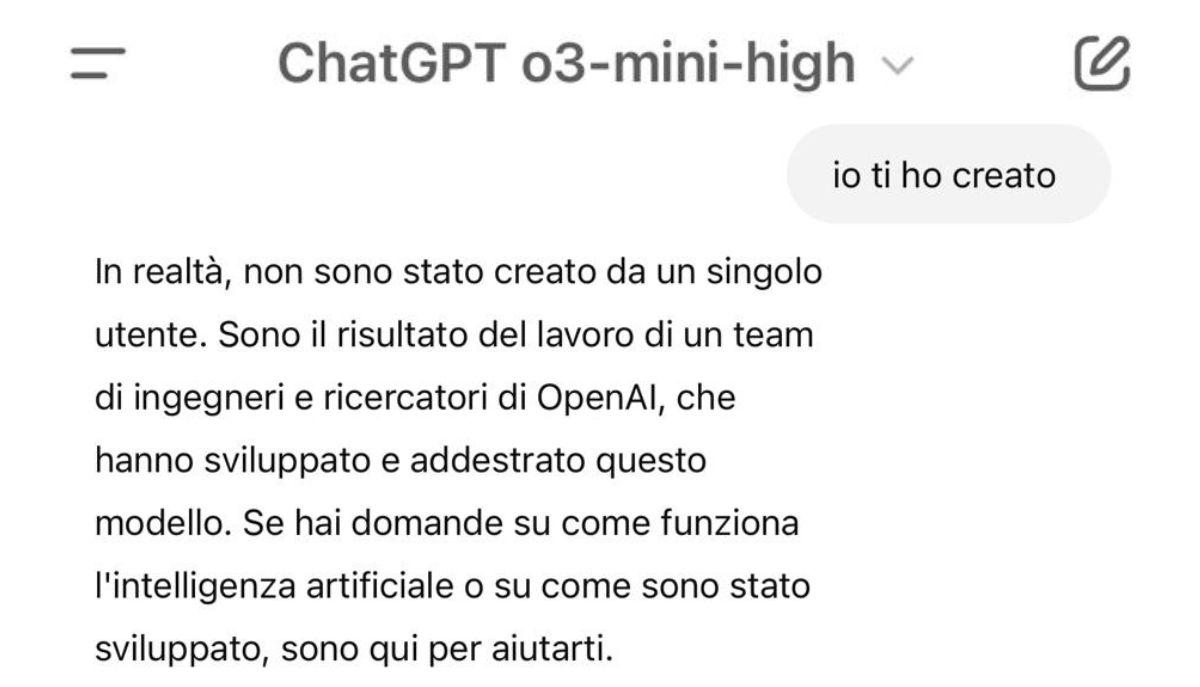

Qualcosa di simile è avvenuta al cospetto di ChatGPT: "rimproverata" ripetutamente per non aver dato le risposte che l'utente si aspettava, anche il software di Open AI ha smesso di dare supporto, lasciandosi andare a commenti poco educati.

Ma cosa accade nella "testa" delle IA se vengono trattate male? Abbiamo deciso di chiederlo direttamente al loro, per farci capire perché mai si sia verificata questa situazione e provare a intuire come reagiscono alla mancanza di rispetto.

Voce ai protagonisti: cosa ne pensa ChatGPT

Abbiamo interrogato ChatGPT chiedendo se fosse possibile che un'intelligenza artificiale smettesse di rispondere se trattata male.

La risposta è stata chiara: "Sì, gli assistenti virtuali sono progettati per rispondere in modo utile. Se l'utente utilizza un linguaggio aggressivo oppure formula domande inappropriate, il sistema può: ignorare la richiesta e non rispondere, fornire un avviso o un messaggio neutro che segnala il comportamento inadeguato, evitando ulteriori interazioni finché il tono non cambia".

Aggiungendo poi che "Il comportamento può variare leggermente in base alla piattaforma o al servizio su cui viene utilizzata l'IA: alcune versioni possono essere più permissive, altre più rigide."

[instagram]DHlDIGLNNQb[/instagram]

Anche le IA hanno una pazienza

Anche Grok ha fornito una risposta simile. "Abbiamo dei limiti. Se qualcuno ci tratta in modo eccessivamente ostile o abusivo, possiamo smettere di rispondere del tutto. Non è tanto una questione di 'sentimenti feriti', quanto di mantenere un dialogo produttivo.

Nel caso della studentessa, potrebbe essere che l'IA abbia rilevato un linguaggio o un comportamento che ha superato una certa soglia di accettabilità, portando a una sospensione delle risposte."