Superficie de ataque en la robotización militar: desafíos y vectores críticos de ciberseguridad

La robotización de unidades militares —como drones, vehículos autónomos, robots de combate y sistemas logísticos automatizados— está avanzando rápidamente. Podemos debatir si es conveniente o no, porque por un lado sustituye y evita que soldados humanos entren en combate directo pero por otro puede resultar una fuerza devastadora dañando infraestructuras e incluso más vidas, pero sea como fuere no podemos evitar que su evolución sea un hecho que está re-definiendo la dinámica de los conflictos modernos. Desde vehículos no tripulados hasta enjambres de drones autónomos, la dependencia de software, inteligencia artificial y conectividad inalámbrica introduce una nueva dimensión de vulnerabilidades y nuevas superficies de ataque desde el punto de vista de la ciberseguridad:Sistemas operativos embebidosEnlaces de comunicación en tiempo real (RF, satélite, LTE/5G)Sensores y actuadores conectadosModelos de IA entrenados para la toma de decisionesCada capa representa un punto de entrada potencial para actores hostiles, desde ejércitos estatales hasta grupos de cibercriminales con motivaciones políticas o económicas. Vamos a introducir una serie de artículos relacionados con este tema tan apasionante, primero empezando a enumerar algunas de las posibilidades más relevantes de ataque contra estos sistemas:1. Intercepción y manipulación de comunicacionesAtaques MITM (Man-In-The-Middle): interceptar las comunicaciones entre el robot y su centro de mando.Spoofing: suplantación de señales GPS o comandos de control para desorientar o redirigir el sistema.Jamming: bloqueo de señales de radio o GPS, dejándolos ciegos o inoperativos.2. Intrusión en sistemas operativos o firmwareExplotación de vulnerabilidades en el software de control o firmware del robot.Uso de malware militarizado para alterar funciones, recopilar inteligencia o causar daños físicos (estilo Stuxnet).Backdoors plantados en la etapa de desarrollo o integración.3. Ataques a la IA o algoritmos de decisiónAdversarial AI: introducir datos diseñados para confundir a los sistemas de reconocimiento de imágenes o decisiones automáticas.Data poisoning: contaminar los datos de entrenamiento de los modelos de IA para inducir errores en situaciones reales.4. Compromiso de la cadena de suministroInclusión de hardware o software malicioso en componentes antes de ser ensamblados (chips, sensores, firmware de terceros).Ingeniería social o ataques a contratistas subcontratados.5. Secuestro y reutilización del sistemaUna vez comprometido, un sistema robótico puede ser reutilizado para atacar a sus propios aliados o recopilar información sensible.También pueden ser "secuestrados" para provocar fallos, caos en el campo de batalla o desinformación.¿Cómo lo veis? Factibles en principio, ¿Verdad? Lejos queda ya el sonado Stuxnet (2010): se han hecho y se continúan haciendo múltiples pruebas e investigaciones, desde por ejemplo el spoofing de drones civiles hasta simulaciones más serias como las de DARPA y ejercicios de red team del Pentágono, que han demostrado cómo incluso los modelos de IA más avanzados pueden ser engañados o corrompidos. La robotización militar no solo transforma el campo de batalla, sino que también traslada la guerra al ciberespacio. Cada sensor, cada decisión autónoma, y cada bit transmitido representa una puerta abierta para potenciales atacantes. Asegurar estos sistemas no es solo una cuestión técnica, sino una prioridad estratégica para cualquier fuerza moderna.En siguientes posts seguiremos ahondando sobre esta temática...

La robotización de unidades militares —como drones, vehículos autónomos, robots de combate y sistemas logísticos automatizados— está avanzando rápidamente. Podemos debatir si es conveniente o no, porque por un lado sustituye y evita que soldados humanos entren en combate directo pero por otro puede resultar una fuerza devastadora dañando infraestructuras e incluso más vidas, pero sea como fuere no podemos evitar que su evolución sea un hecho que está re-definiendo la dinámica de los conflictos modernos.

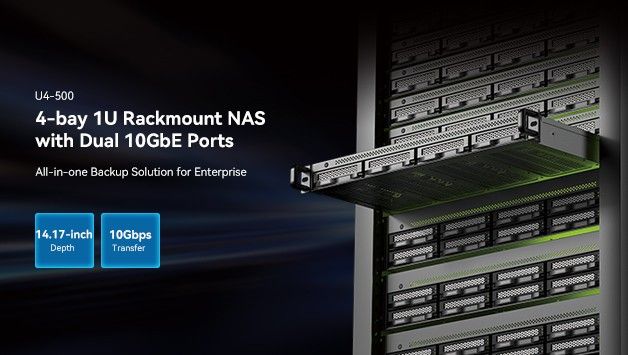

Desde vehículos no tripulados hasta enjambres de drones autónomos, la dependencia de software, inteligencia artificial y conectividad inalámbrica introduce una nueva dimensión de vulnerabilidades y nuevas superficies de ataque desde el punto de vista de la ciberseguridad:

- Sistemas operativos embebidos

- Enlaces de comunicación en tiempo real (RF, satélite, LTE/5G)

- Sensores y actuadores conectados

- Modelos de IA entrenados para la toma de decisiones

Cada capa representa un punto de entrada potencial para actores hostiles, desde ejércitos estatales hasta grupos de cibercriminales con motivaciones políticas o económicas.

Vamos a introducir una serie de artículos relacionados con este tema tan apasionante, primero empezando a enumerar algunas de las posibilidades más relevantes de ataque contra estos sistemas:

1. Intercepción y manipulación de comunicaciones

- Ataques MITM (Man-In-The-Middle): interceptar las comunicaciones entre el robot y su centro de mando.

- Spoofing: suplantación de señales GPS o comandos de control para desorientar o redirigir el sistema.

- Jamming: bloqueo de señales de radio o GPS, dejándolos ciegos o inoperativos.

2. Intrusión en sistemas operativos o firmware

- Explotación de vulnerabilidades en el software de control o firmware del robot.

- Uso de malware militarizado para alterar funciones, recopilar inteligencia o causar daños físicos (estilo Stuxnet).

- Backdoors plantados en la etapa de desarrollo o integración.

3. Ataques a la IA o algoritmos de decisión

- Adversarial AI: introducir datos diseñados para confundir a los sistemas de reconocimiento de imágenes o decisiones automáticas.

- Data poisoning: contaminar los datos de entrenamiento de los modelos de IA para inducir errores en situaciones reales.

4. Compromiso de la cadena de suministro

- Inclusión de hardware o software malicioso en componentes antes de ser ensamblados (chips, sensores, firmware de terceros).

- Ingeniería social o ataques a contratistas subcontratados.

5. Secuestro y reutilización del sistema

- Una vez comprometido, un sistema robótico puede ser reutilizado para atacar a sus propios aliados o recopilar información sensible.

- También pueden ser "secuestrados" para provocar fallos, caos en el campo de batalla o desinformación.

¿Cómo lo veis? Factibles en principio, ¿Verdad? Lejos queda ya el sonado Stuxnet (2010): se han hecho y se continúan haciendo múltiples pruebas e investigaciones, desde por ejemplo el spoofing de drones civiles hasta simulaciones más serias como las de DARPA y ejercicios de red team del Pentágono, que han demostrado cómo incluso los modelos de IA más avanzados pueden ser engañados o corrompidos. La robotización militar no solo transforma el campo de batalla, sino que también traslada la guerra al ciberespacio. Cada sensor, cada decisión autónoma, y cada bit transmitido representa una puerta abierta para potenciales atacantes. Asegurar estos sistemas no es solo una cuestión técnica, sino una prioridad estratégica para cualquier fuerza moderna.

En siguientes posts seguiremos ahondando sobre esta temática...

_FotoRaymar_MAEFArchivo-U03228130150TBG-1024x512@diario_abc.jpg)