Las estafas millonarias usando Inteligencia Artificial desarticuladas en España: desde criptoestafas hasta pornografía infantil

La policía desmantela una organización criminal que estafó 19 millones de euros utilizando vídeos manipulados con inteligencia artificial.

El Ministerio del Interior ha informado de tres operaciones para desmantelar ciberestafas realizadas con inteligencia artificial en lo que va de 2025. La última ha conducido a la desarticulación de una organización criminal que había estafado 19 millones de euros utilizando vídeos manipulados con inteligencia artificial, ha informado Interior.

- La Guardia Civil y la Policía Nacional han detenido a seis personas en el marco de la operación “Coinblack-Wendimine”.

- En total, 208 personas han sido estafadas a través de falsas inversiones en criptomonedas.

¿En qué consistió la ciberestafa? Los ciberdelincuentes introducían publicidad en páginas web para estafar a potenciales clientes mediante supuestas inversiones en criptomonedas a través de personas famosas recreadas con inteligencia artificial. Esta selección no se realizaba al azar sino a través de algoritmos para engañar más fácilmente a las víctimas.

- Ofrecían inversiones con “una alta rentabilidad y nula posibilidad de pérdida patrimonial”.

Después de que las víctimas transfirieran a criptomonedas el dinero a través de sus cuentas, empezaban los problemas, por lo que se daban cuenta de que habían sido estafadas. Las detenciones se han realizado en Alicante, Torrevieja, Santa Pola y Villajoyosa. A todos ellos se les imputan delitos de estafa, blanqueo de capitales y falsedad documental.

Otras operaciones relacionadas con la inteligencia artificial

Hace mes y medio, la Policía Nacional, junto a la Interpol, detuvo a 25 miembros de una organización criminal dedicada a distribuir imágenes de abuso infantil generadas por inteligencia artificial, informó Interior.

- Se trata de “uno de los primeros casos en los que se investiga material de abuso sexual infantil generado íntegramente por inteligencia artificial”, aseguran los investigadores.

El origen. La investigación comenzó tras la detención en 2024 de un ciudadano danés que dirigía una plataforma online a través de la que se distribuía material generado por IA que producía previamente. Así, usuarios de todo el mundo, tras realizar un pago simbólico, obtenían una contraseña para visualizar imágenes en las que había abuso sexual a menores.

- El material sexual infantil autogenerado supone una parte importante del abuso sexual a menores detectado.

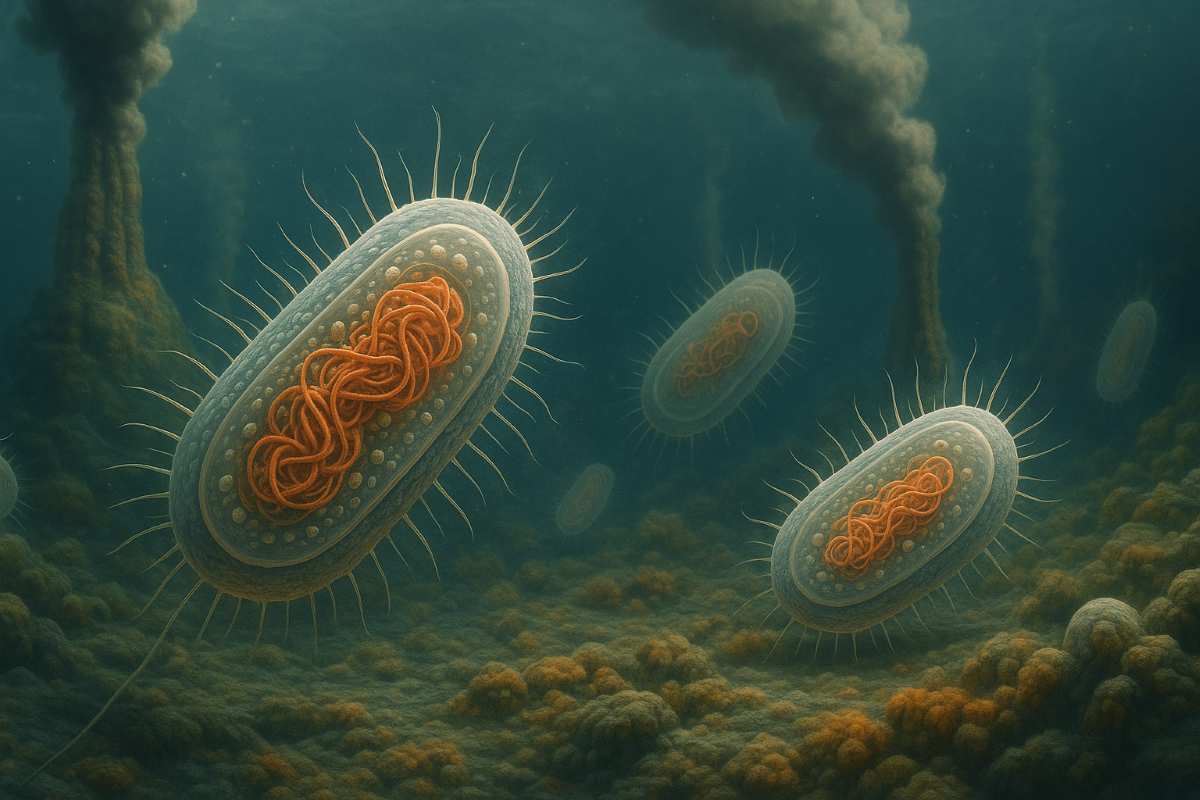

- Los delincuentes utilizan modelos de IA “capaces de generar o alterar imágenes” para producir material de abuso sexual infantil y extorsión sexual.

Estos modelos, afirma la investigación, “están ampliamente disponibles y se han desarrollado rápidamente”, con resultados que se parecen cada vez más a las imágenes reales. Este hecho hace cada vez más difícil identificarlo como material generado por IA y plantea “importantes desafíos a las autoridades” a la hora de identificar a las verdaderas víctimas.

Por otro lado, las autoridades policiales detuvieron el 29 de enero a dos personas por su presunta implicación en delitos de descubrimiento y revelación de secretos, blanqueo de capitales y organización criminal, informó Interior.

- La operación concluyó con la intervención de los foros de cibercrimen internacional Cracked y Nulled, que ofrecían herramientas y programas basados en IA para “buscar automáticamente vulnerabilidades de seguridad y optimizar los ataques informáticos”.

- Los agentes incautaron, además, criptoactivos por valor de más de 234.000 euros.

Estas plataformas ejecutaban sus ciberestafas desarrollando y compartiendo técnicas de phishing y utilizando inteligencia artificial “para crear mensajes más personalizados y convincentes”.