OpenAI lança o3 e o4-Mini, modelos de IA que conseguem “pensar com imagens”

Inteligência artificial é capaz de processar imagens várias vezes até dar uma resposta, podendo girar, dar zoom e recortar OpenAI lança o3 e o4-Mini, modelos de IA que conseguem “pensar com imagens”

A OpenAI lançou, nesta quarta-feira (16/04), dois novos modelos de inteligência artificial: o o3 e o o4-Mini. Ambos são modelos de “raciocínio”, que simulam uma linha de pensamento antes de responder, e trazem como principal novidade o uso de imagens nesse processo.

“O o3 e o o4-Mini são os mais recentes modelos visuais de raciocínio da nossa série o. Pela primeira vez, nossos modelos podem pensar com imagens — e não apenas vê-las — em suas linhas de raciocínio”, escreve a desenvolvedora do ChatGPT em seu comunicado.

Introducing OpenAI o3 and o4-mini—our smartest and most capable models to date.

For the first time, our reasoning models can agentically use and combine every tool within ChatGPT, including web search, Python, image analysis, file interpretation, and image generation. pic.twitter.com/rDaqV0x0wE— OpenAI (@OpenAI) April 16, 2025

Além disso, eles conseguem fazer buscas na internet e gerar imagens, combinando ferramentas já disponíveis em outros modelos da empresa.

Este é o segundo lançamento da OpenAI nesta semana. Na segunda-feira (14/04), a empresa anunciou o GPT-4.1, focado em escrita e imagens.

O que significa “pensar com imagens”?

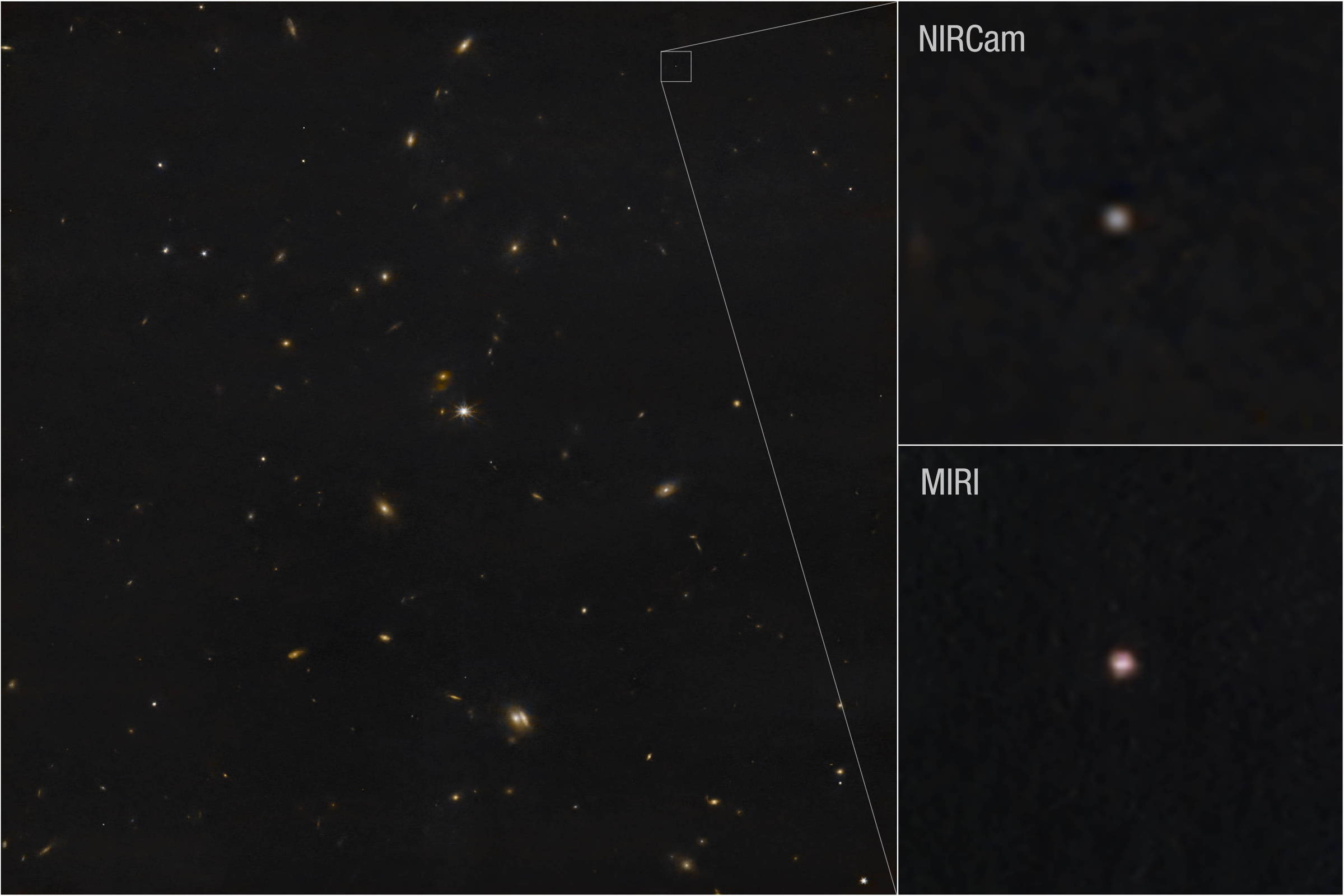

Com “pensar com imagens”, a OpenAI quer dizer que os modelos são capazes de processar diversas vezes as imagens enviadas, como parte do processo de simular o raciocínio. Isso significa, por exemplo, recortar, dar zoom, girar ou inverter as fotos fornecidas pelo usuário no prompt, até chegar a uma resposta satisfatória.

A empresa dá alguns exemplos disso:

- O usuário envia uma foto de um caderno de cabeça para baixo e pede para a IA dizer o que está escrito. O modelo pode girar a imagem em 180 graus antes de aplicar o reconhecimento de caracteres.

- O usuário envia uma foto de uma mesa com um computador e um caderno e pede para resolver o problema da esquerda. A IA aplica diversos recortes até encontrar qual é a questão e, então, solucioná-la.

- O usuário envia uma foto de uma rua no Japão. Na imagem, há um ponto de ônibus, um guarda e um veículo em movimento. Ele, então, pede para identificar que ponto é aquele e com que frequência passa o ônibus. A IA recorta a foto, reconhece os caracteres, traduz para o inglês e pesquisa os horários na internet.

Qual é a diferença entre o o3 e o o4-Mini?

Segundo a OpenAI, o o3 é seu modelo de raciocínio mais avançado, com “desempenho sólido” em programação, matemática e ciência. Já o o4-Mini é uma alternativa de menor custo, mas ainda capaz de oferecer “resultados impressionantes”, segundo a companhia.

Quando o o3 e o o4-Mini serão lançados?

Usuários dos planos Plus, Pro e Team do ChatGPT terão acesso ao o3 e ao o4-Mini a partir desta quarta-feira (16/04). Daqui a algumas semanas, assinantes do plano Pro terão acesso a uma versão mais potente do o3, chamada o3-Pro.

Com informações da OpenAI, Axios, Engadget e The Verge

OpenAI lança o3 e o4-Mini, modelos de IA que conseguem “pensar com imagens”

.jpg)