La IA se está volviendo cada vez más inteligente. El problema es que también está alucinando cada vez más

La inteligencia artificial nos está dejando con la boca abierta por sus avances, pero hay un problema importante: cuanto más lista se vuelve, más se inventa. Y no hablamos de pequeños errores, sino de datos completamente falsos que parecen reales. No es una cuestión menor, ya que los últimos modelos de OpenAI mienten constantemente según demuestran sus datos internos y lo que confirman los expertos del sector.Tal y como nos informan desde Futurism, los chatbots y asistentes más modernos están cometiendo errores graves con demasiada frecuencia, algo preocupante cuando dependemos de ellos para buscar información, generar textos o incluso para consultar horarios de transporte.La paradoja tecnológica que nadie esperabaLos últimos modelos de OpenAI, como el o3 y o4-mini, mienten un 33% y 48% del tiempo respectivamente en pruebas controladas, el doble que sus versiones anteriores. Esto rompe una regla que parecía básica: que las IA más potentes deberían ser más precisas, pero está ocurriendo justamente lo contrario. La tecnología más avanzada es la que más falla."Por mucho que lo intentemos, siempre alucinarán. Eso nunca desaparecerá", asegura Amr Awadallah, CEO de Vectara. Es como si estas herramientas tuvieran un defecto de nacimiento que no se puede corregir y que, curiosamente, empeora cuando mejoran en otros aspectos.El problema se nota especialmente en móviles, donde Google ha metido Gemini Nano en Android y Chrome para reforzar la seguridad. Pero ¿de qué sirve esto si los asistentes basados en IA inventan restaurantes o te dan direcciones erróneas cuando más las necesitas?Lo que hace todo más complicado es que ahora usan "datos sintéticos", es decir, información creada por otras IAs, para entrenar a las nuevas. Esto podría estar creando un efecto bola de nieve donde cada generación arrastra y multiplica los errores de la anterior, a pesar de que Sam Altman presume de que ChatGPT-4.5 es casi humano en su forma de responder.OpenAI, Google y Baidu con sus modelos Ernie están en plena carrera por dominar el mercado, pero todos sus sistemas fallan por igual. Y aquí está lo preocupante: cada vez que mejoran en tareas complejas, las nuevas versiones son menos fiables en las cosas básicas.Que existan empresas como Okahu, dedicadas sólo a reducir estas alucinaciones, nos da una idea de lo serio que es el asunto. Como dice su cofundador Pratik Verma: "Si no arreglamos esto, la IA no sirve para nada". Este problema afecta tanto a ChatGPT como a sus alternativas como Perplexity o Duck.ai, e incluso a los modelos que puedes instalar en tu ordenador.Mientras las empresas gastan miles de millones para lanzar novedades cada vez más rápido, los usuarios actualizan sus aplicaciones sin saber que quizás están instalando versiones menos fiables que las anteriores. Toda una paradoja para una tecnología que prometía hacernos la vida más fácil.El artículo La IA se está volviendo cada vez más inteligente. El problema es que también está alucinando cada vez más fue publicado originalmente en Andro4all.

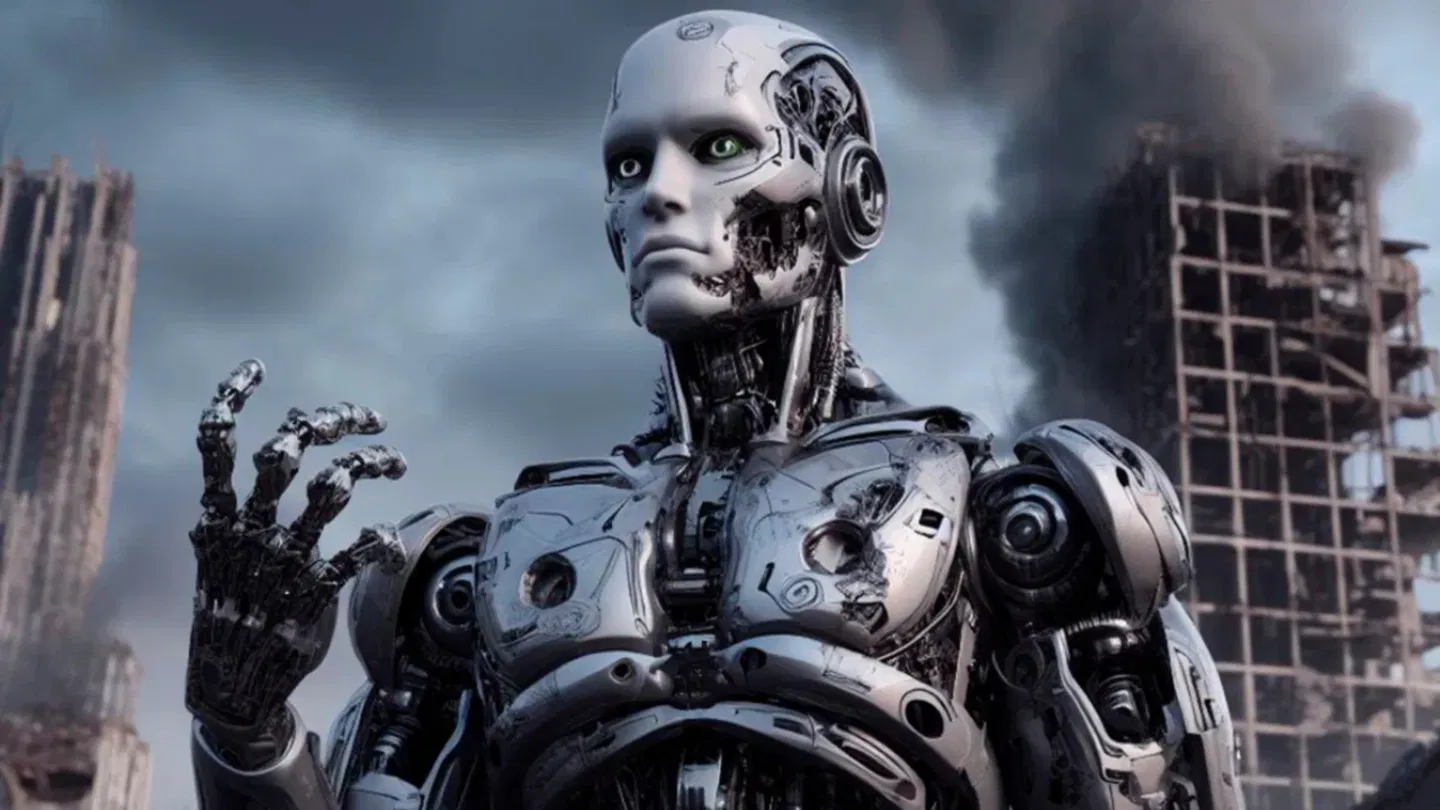

La inteligencia artificial nos está dejando con la boca abierta por sus avances, pero hay un problema importante: cuanto más lista se vuelve, más se inventa. Y no hablamos de pequeños errores, sino de datos completamente falsos que parecen reales. No es una cuestión menor, ya que los últimos modelos de OpenAI mienten constantemente según demuestran sus datos internos y lo que confirman los expertos del sector.

Tal y como nos informan desde Futurism, los chatbots y asistentes más modernos están cometiendo errores graves con demasiada frecuencia, algo preocupante cuando dependemos de ellos para buscar información, generar textos o incluso para consultar horarios de transporte.

La paradoja tecnológica que nadie esperaba

Los últimos modelos de OpenAI, como el o3 y o4-mini, mienten un 33% y 48% del tiempo respectivamente en pruebas controladas, el doble que sus versiones anteriores. Esto rompe una regla que parecía básica: que las IA más potentes deberían ser más precisas, pero está ocurriendo justamente lo contrario. La tecnología más avanzada es la que más falla.

"Por mucho que lo intentemos, siempre alucinarán. Eso nunca desaparecerá", asegura Amr Awadallah, CEO de Vectara. Es como si estas herramientas tuvieran un defecto de nacimiento que no se puede corregir y que, curiosamente, empeora cuando mejoran en otros aspectos.

El problema se nota especialmente en móviles, donde Google ha metido Gemini Nano en Android y Chrome para reforzar la seguridad. Pero ¿de qué sirve esto si los asistentes basados en IA inventan restaurantes o te dan direcciones erróneas cuando más las necesitas?

Lo que hace todo más complicado es que ahora usan "datos sintéticos", es decir, información creada por otras IAs, para entrenar a las nuevas. Esto podría estar creando un efecto bola de nieve donde cada generación arrastra y multiplica los errores de la anterior, a pesar de que Sam Altman presume de que ChatGPT-4.5 es casi humano en su forma de responder.

OpenAI, Google y Baidu con sus modelos Ernie están en plena carrera por dominar el mercado, pero todos sus sistemas fallan por igual. Y aquí está lo preocupante: cada vez que mejoran en tareas complejas, las nuevas versiones son menos fiables en las cosas básicas.

Que existan empresas como Okahu, dedicadas sólo a reducir estas alucinaciones, nos da una idea de lo serio que es el asunto. Como dice su cofundador Pratik Verma: "Si no arreglamos esto, la IA no sirve para nada". Este problema afecta tanto a ChatGPT como a sus alternativas como Perplexity o Duck.ai, e incluso a los modelos que puedes instalar en tu ordenador.

Mientras las empresas gastan miles de millones para lanzar novedades cada vez más rápido, los usuarios actualizan sus aplicaciones sin saber que quizás están instalando versiones menos fiables que las anteriores. Toda una paradoja para una tecnología que prometía hacernos la vida más fácil.

El artículo La IA se está volviendo cada vez más inteligente. El problema es que también está alucinando cada vez más fue publicado originalmente en Andro4all.