Apple remove aplicativos que utilizavam IA para gerar imagens de nudez não autorizadas

A decisão foi tomada após uma investigação revelar que esses apps estavam sendo promovidos no TikTok com a promessa de "tirar a roupa" de qualquer pessoa em fotos.

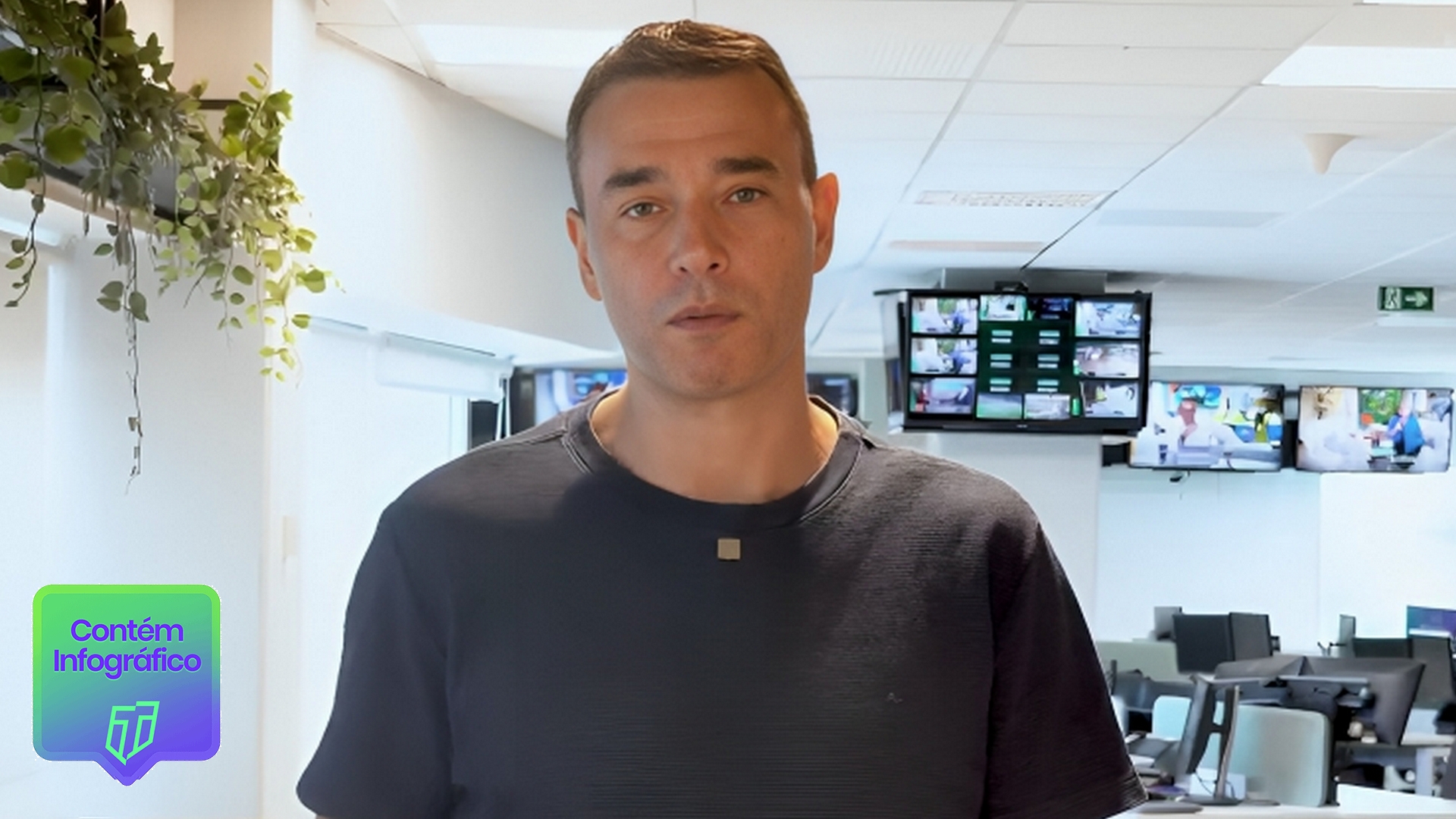

A Apple removeu da App Store um grupo de aplicativos que usavam inteligência artificial para criar imagens sexualizadas de pessoas sem o consentimento delas. A decisão foi tomada após uma investigação revelar que esses apps estavam sendo promovidos no TikTok com a promessa de "tirar a roupa" de qualquer pessoa em fotos.

Alguns aplicativos conhecidos como ferramentas de "nudificação" foram inicialmente apresentados em suas páginas oficiais como formas de "apimentar selfies". No entanto, anúncios pagos veiculados no TikTok indicavam que o objetivo real era gerar deepfakes, removendo roupas digitais de mulheres e criando imagens sugestivas sem autorização.

Um estudo feito pela BBC apontou que os anúncios incentivavam o uso dos aplicativos para visualizar "as fotos mais quentes da sua paixão" ou "colocar qualquer um de biquíni", em muitos casos sem qualquer menção ao consentimento. Algumas propagandas chegaram a utilizar imagens manipuladas de atrizes conhecidas para exemplificar o funcionamento dos aplicativos.

![<![CDATA[ Filmes, séries e documentários sobre os bastidores da Igreja Católica ]]>](https://cdn.sabado.pt/images/2025-04/img_182x101$2025_04_27_15_49_12_736547.jpg?#)

![<![CDATA[ Em caso de apagão elétrico o que fazer em casa e na rua? ]]>](https://cdn.sabado.pt/images/2025-04/img_1200x676%242025_04_28_18_52_45_736712.jpg)

![<![CDATA[ Von der Leyen falou com Montenegro e promete ajudar o País ]]>](https://cdn.sabado.pt/images/2024-10/img_182x101$2024_10_30_19_32_04_725572.jpg?#)

.png)

.jpg)