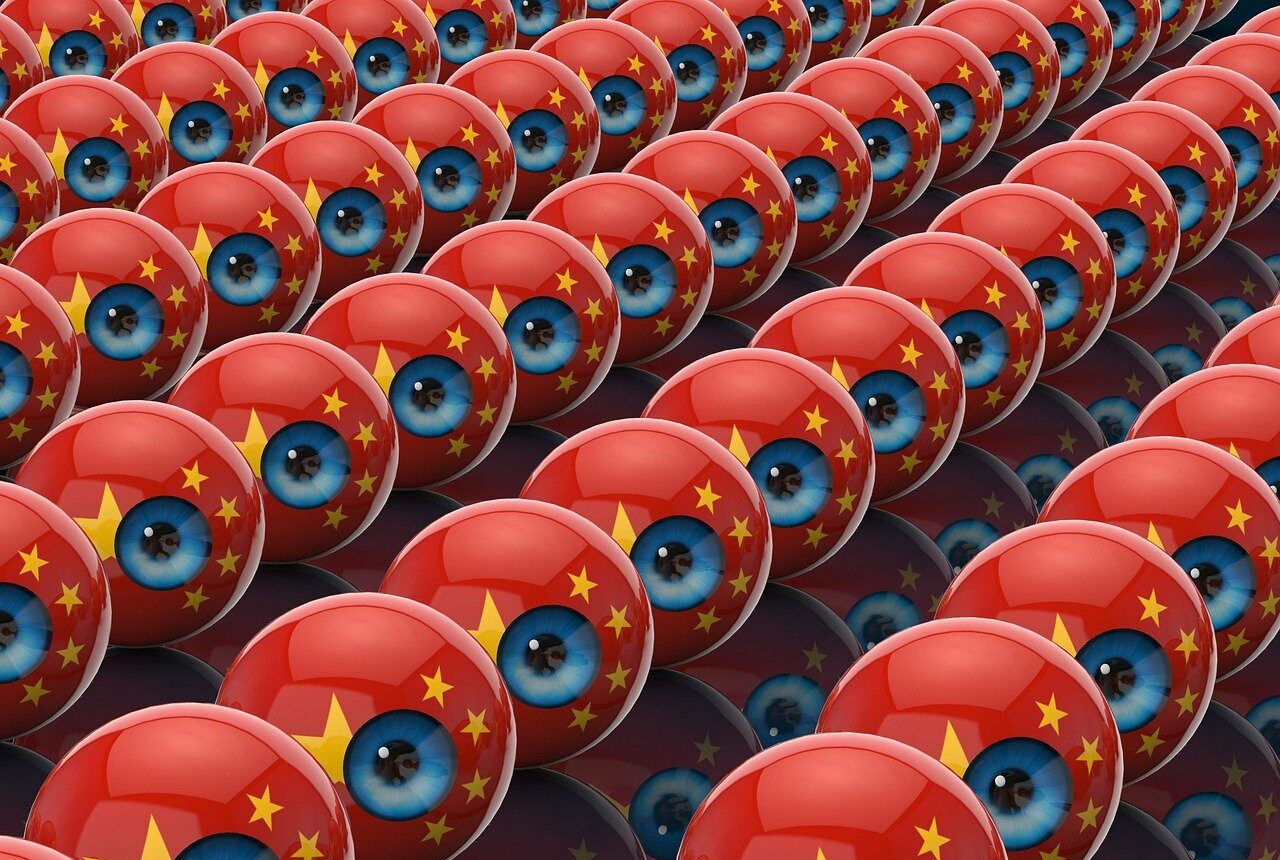

Ecco come la Cina spia e fa propaganda grazie a ChatGpt

OpenAI ha bandito dai suoi utenti di ChatGpt diverse reti di malintenzionati che sfruttavano l'intelligenza artificiale per spiare Paesi, diffondere disinformazione e fare propaganda in varie lingue. L'articolo di Le Monde

OpenAI ha bandito dai suoi utenti di ChatGpt diverse reti di malintenzionati che sfruttavano l’intelligenza artificiale per spiare Paesi, diffondere disinformazione e fare propaganda in varie lingue. L’articolo di Le Monde

OpenAI, casa madre di ChatGPT, ha bandito dai suoi utenti diverse reti di malintenzionati, che secondo tutte le probabilità lavorano in Cina. In un rapporto sulla sicurezza pubblicato venerdì 21 febbraio, scrive Le Monde, l’azienda racconta di aver individuato un’operazione di disinformazione e la creazione di uno strumento di sorveglianza dei social network.

UNO STRUMENTO DI CONTROLLO PER PECHINO

I team di sicurezza dell’azienda americana hanno individuato questi utenti monitorando l’utilizzo di ChatGPT. Studiando l’attività di un gruppo di account che lavorano in lingua cinese e durante l’orario di ufficio cinese, OpenAI è stata in grado di ricostruire i contorni dello strumento su cui stavano lavorando: un programma che analizza in tempo reale i messaggi di Facebook, X, YouTube, Instagram, Telegram e Reddit, concentrandosi in particolare sugli inviti a manifestazioni a favore dei diritti umani.

Chiamato “Peer Review” da OpenAI, questo strumento avrebbe il compito di segnalare questi messaggi alle autorità cinesi e alle sue ambasciate all’estero. Tra i paesi sorvegliati ci sono Stati Uniti, Germania e Regno Unito. E tra i temi osservati: il sostegno agli uiguri e la diplomazia nella regione indo-pacifica. […]

PROPAGANDA E DISINFORMAZIONE…

OpenAI è stata anche in grado di seguire l’attività di una seconda rete di attori cinesi impegnati in operazioni di disinformazione. Questi ultimi utilizzano ChatGPT per generare brevi messaggi pubblicati sui social network, denigrando in particolare i post su X della dissidente Cai Xia, ex professoressa della Scuola Centrale del Partito Comunista Cinese (PCC).

Presente al vertice sull’intelligenza artificiale organizzato a Parigi all’inizio di febbraio, Ben Nimmo, investigatore capo di OpenAI, aveva menzionato un esempio simile sventato di recente dai suoi team. Alcuni utenti cinesi avevano utilizzato ChatGPT per rafforzare la campagna di disinformazione “Spamouflage”, ricorrendo al generatore di intelligenza artificiale per scrivere tweet favorevoli al PCC e ostili all’Occidente, nonché per creare siti critici nei confronti dei dissidenti all’estero. […]

…IN MOLTE LINGUE PER ARRIVARE A TUTTI

Il gruppo che prende di mira Cai Xia è probabilmente diverso. I suoi membri hanno utilizzato ChatGPT per produrre lunghi articoli di critica verso gli Stati Uniti, che sono riusciti a pubblicare in una decina di importanti giornali messicani, peruviani ed ecuadoriani, a volte sotto forma di contenuti sponsorizzati. Più precisamente, l’IA è stata utilizzata per tradurre e ampliare articoli cinesi preesistenti che mettevano in evidenza argomenti controversi come la violenza politica, la discriminazione, il sessismo o la politica estera, spiegandoli attraverso la debolezza della leadership politica americana.

Da oltre un anno OpenAI pubblica rapporti sulla sicurezza, il cui obiettivo è, tra l’altro, quello di “prevenire l’uso di strumenti di IA da parte di regimi autoritari per rafforzare il loro potere o il controllo sui cittadini, per minacciare o costringere altri Stati o per condurre operazioni di influenza sotto copertura”. Gli stessi investigatori utilizzano strumenti basati sull’IA.

(Estratto dalla rassegna stampa estera a cura di eprcomunicazione)