Googles Echtzeit-AI im Roll-out: So wird Gemini zu deinen Augen

Erste User können mit Gemini in Echtzeit Dinge vor der Kamera und auf ihrem Screen KI-gestützt ansehen und analysieren lassen. Das hilft auf Reisen, bei der Arbeit und im Alltag, ist aber auch mit anderen KI-Lösungen möglich.

AI Tools können sehen, was du siehst, wissen in der Regel über das Gesehene aber mehr als du – oder können es zumindest schneller herausfinden. Dieser Grundsatz führt dazu, dass die großen Tech-Unternehmen dieser Welt KI-Lösungen bereitstellen, mit denen du in Echtzeit Gesehenes auf deinem Screen oder vor der Smartphone-Kamera analysieren lassen kannst. So kannst du zum Beispiel unbekannte Sightseeing-Objekte in Sekundenschnelle einordnen oder dir KI-gestützte Hilfestellung bei Kaufentscheidungen sichern.

Nach OpenAI mit den eigenen Screensharing- und Videofunktionen eine entsprechende Lösung vorgestellt hatte, begann auch Google im März 2025 endlich mit dem Launch der Gemini Live Features im Project Astra. Diese hatte Google bereits vor Monaten präsentiert.

Endlich ChatGPT Screensharing und Custom Instructions Update in Deutschland

Gemini Live sieht für dich – Zugriff bisher noch begrenzt

Erst Nutzer:innen können Gemini Live jetzt derart nutze, dass die KI-Lösung Screen-Inhalte oder Dinge vor der Kamera sieht und in Echtzeit einordnet. Davon berichtet Wes Davis für The Verge. Menaka Shroff, Senior Director für Global Android Marketing, gab bereits vor wenigen Wochen bekannt, dass Google die neuen Gemini Live Features für die ersten User zur Verfügung stellt. Dabei handelt es sich um Gemini Advanced Subscriber, die Google One AI Premium abonniert haben. Diese Features sind aus der Vorstellung von Googles Project Astra bereits bekannt.

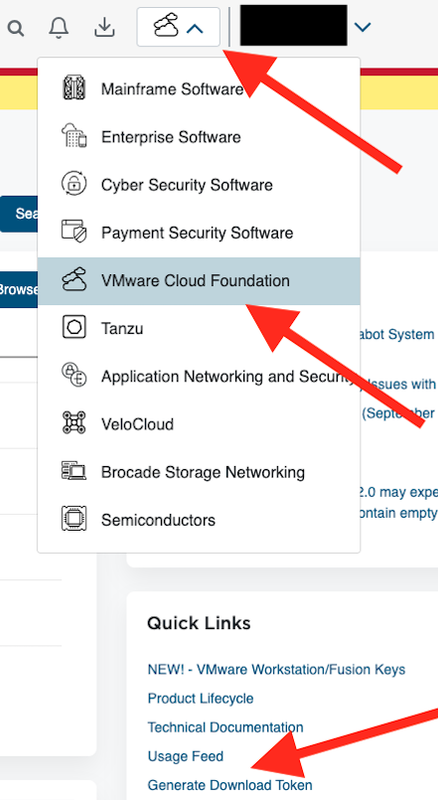

Mit dem Project Astra lotet Google Perspektiven und Einsatzoptionen für die AI-Assistenz aus. So können User über Android Phones die KI nutzen, um Konversationen in diversen Sprachen (auch gemixt) führen zu lassen, Produkte wie Lens, Maps und Search miteinzubeziehen, Konversationen zu erinnern und mit geringerer Latenz Antworten der KI zu erhalten. Diese Optoinen wurden auch in die Gemini App übertragen. Und die ersten Anwendungsbeispiele von Nutzer:innen sind schon aufgetaucht. Im Subreddit r/Bard zu Gemini teilen einige User Beispiele.

A short demo of Project Astra (Share screen with Live)

byu/Kien_PS inBard

[BREAKING] Gemini Live Screen and Video Sharing ROLLING OUT!

byu/himynamesecho inBard

Diese Beispiele beziehen sich auf die Screenreading-Funktion, welche das Verständnis auf dem gerät zu sehender Videos, Beiträge, Bilder und dergleichen mehr fördert. OpenAIs Feature für ChatGPT funktioniert ganz ähnlich.

Live-Video: Mit deinen und Geminis Augen auf die Welt sehen

Darüber hinaus gibt es die Live-Videofunktion. Diese ermöglicht der KI, live mit der Kamera gefilmte Elemente zu sehen und zu analysieren. Das können Bauwerke oder Plakate sein, Produkte im Supermarkt oder fremde Schriften. Gemini kann Informationen zum Gesehenen liefern – oder Tipps für bestimmte Kontexte geben. Im Beispiel von Google beantwortet die KI die Frage nach den passenden Glasurfarben für getöpferte Produkte, die einen „Mid-Century Modern Look“ erhalten sollen anhand der Ansicht der noch unglasierten Objekte und einer Farbübersicht.

Die neuen Gemini Live Features sind noch nicht für alle User verfügbar. Sie dürften aber nach und nach integriert werden, damit Google mit OpenAI und anderen Tech-Unternehmen Schritt hält und das breite Angebot an KI-Lösungen prominent macht. Gemini Live basiert auf der Power von Gemini 2.0, Googles bisher leistungsfähigstem KI-Modell. Dieses bietet in diversen Kontexten Lösungen am Puls der Zeit. Zum Beispiel für Podcast-Style-Zusammenfassungen deiner Dokumente mit Audio Overview oder für maßgeschneiderte KI-Suchergebnisse unter Einbeziehung deiner Suchhistorie.

Gemini 2.0:

So kannst du Googles Mega-KI-Modell testen

:quality(80)/p7i.vogel.de/wcms/8d/a5/8da583d92c1ab22b2db24ebdb537f507/0123815569v2.jpeg?#)

,regionOfInterest=(981,663)&hash=4d4735059cc4c4b615911f464c7b575b0baeae84d724e35e70e7e545678eeca5#)