о значащих цифрах

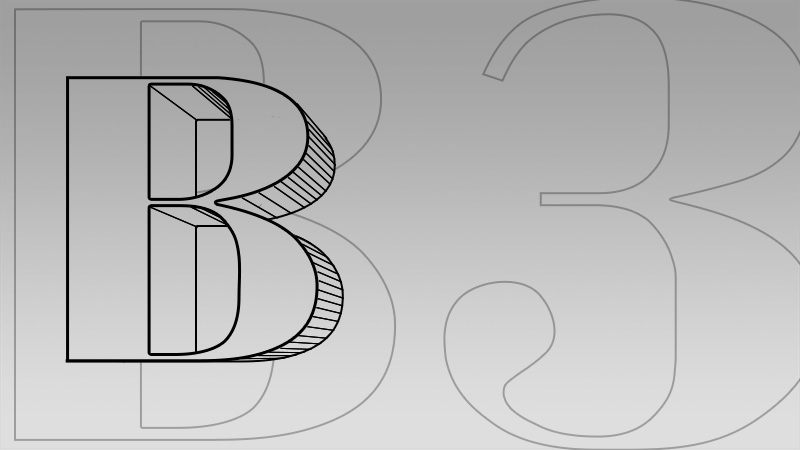

Я читаю сейчас старый олдскульный учебник оптики по-английски (Fundamentals of Optics, Jenkins & White, 4th ed.), он мне очень нравится. В конце книги есть приложение номер VII, где авторы рассказывают правила значащих цифр в числах, которые используются в научных текстах. Например, в числе 0.000345 есть три значащие цифры 345 (нули в начале не считаются), в числе 345 тоже, в числе 34500 тоже (подразумевается, что такое число получено путем округления последних двух цифр), а вот в числе 345.0 четыре значащие цифры, ноль после запятой означает, что там точность до 1/10. Ну вот, в принципе я полагал, что эти правила интуитивно понимаю, и вроде все сходится с написанным в тексте. И тут они пишут следующее (я выделил на фотографии): если вам нужно округлить до трех значащих цифр, но первая ненулевая цифра 1,2 или 3, то округляйте на самом деле до четырех; если же она от 4 до 9, то до трех.Мне никогда не попадалось такое странное правило, разделяющее первую цифру на группы 1-3 и 4-9 (обратите внимание, это не имеет отношения к правилу округления цифры вверх/вниз, речь о *первой* цифре числа, а не последней). Я внимательно прочитал википедию про "significant figures" и не нашел упоминания его. На других страницах, где объясняют значащие цифры, тоже такого не говорят. Что это было? При этом логика такого правила вроде бы ясна: оно помогает немного уравнять *относительную* потерю точности. Если мы имеем дело с числом 9.8, две значащие цифры, то оно представляет разброс возможных истинных значений 9.75-9.85, неточность 0.1 из 9.8, т.е. примерно 1%. А если с числом 1.2, тоже две значащие цифры, то разброс 1.15-1.25, относительная неточность 0.1/1.2 уже близка к 10%. Поэтому, округляя до двух значащих цифр числа 9.823 и 1.244, мы можем предпочесть притвориться, что единица в 1.244 не значащая, и записать их как 9.8 и 1.24 соответственно. Но это такое постфактум оправдание. Факт же, что в обычных объяснениях значащих цифр в Википедии и других учебниках ничего такого не обнаруживается. Откуда взялось правило про 1-3/4-9 и было ли оно "официальным" или общепринятым в каком-то смысле? Я не знаю - если знаете, расскажите.Единственное, что я нашел на эту тему - обсуждение в Physics Stackexchange цитаты из другой книги (Schaum's Outline of Engineering Mechanics), где то тоже правило дается только для первой цифры 1, а не 1-3. В ответах там люди приводят тот же аргумент об относительной потере точности. А, еще интересное сочинение John Denker: "Uncertainty as Applied to Measurements and Calculations". Автор очень не любит значащие цифры: "People who care about their data don’t use sig figs." и "... no matter what you are doing, you can always make it worse by using sig figs". Он подробно аргументирует свою неприязнь, но я не стал вникать. Может, кому интересно.

Например, в числе 0.000345 есть три значащие цифры 345 (нули в начале не считаются), в числе 345 тоже, в числе 34500 тоже (подразумевается, что такое число получено путем округления последних двух цифр), а вот в числе 345.0 четыре значащие цифры, ноль после запятой означает, что там точность до 1/10.

Ну вот, в принципе я полагал, что эти правила интуитивно понимаю, и вроде все сходится с написанным в тексте. И тут они пишут следующее (я выделил на фотографии): если вам нужно округлить до трех значащих цифр, но первая ненулевая цифра 1,2 или 3, то округляйте на самом деле до четырех; если же она от 4 до 9, то до трех.

Мне никогда не попадалось такое странное правило, разделяющее первую цифру на группы 1-3 и 4-9 (обратите внимание, это не имеет отношения к правилу округления цифры вверх/вниз, речь о *первой* цифре числа, а не последней). Я внимательно прочитал википедию про "significant figures" и не нашел упоминания его. На других страницах, где объясняют значащие цифры, тоже такого не говорят. Что это было?

При этом логика такого правила вроде бы ясна: оно помогает немного уравнять *относительную* потерю точности. Если мы имеем дело с числом 9.8, две значащие цифры, то оно представляет разброс возможных истинных значений 9.75-9.85, неточность 0.1 из 9.8, т.е. примерно 1%. А если с числом 1.2, тоже две значащие цифры, то разброс 1.15-1.25, относительная неточность 0.1/1.2 уже близка к 10%. Поэтому, округляя до двух значащих цифр числа 9.823 и 1.244, мы можем предпочесть притвориться, что единица в 1.244 не значащая, и записать их как 9.8 и 1.24 соответственно.

Но это такое постфактум оправдание. Факт же, что в обычных объяснениях значащих цифр в Википедии и других учебниках ничего такого не обнаруживается. Откуда взялось правило про 1-3/4-9 и было ли оно "официальным" или общепринятым в каком-то смысле? Я не знаю - если знаете, расскажите.

Единственное, что я нашел на эту тему - обсуждение в Physics Stackexchange цитаты из другой книги (Schaum's Outline of Engineering Mechanics), где то тоже правило дается только для первой цифры 1, а не 1-3. В ответах там люди приводят тот же аргумент об относительной потере точности.

А, еще интересное сочинение John Denker: "Uncertainty as Applied to Measurements and Calculations". Автор очень не любит значащие цифры: "People who care about their data don’t use sig figs." и "... no matter what you are doing, you can always make it worse by using sig figs". Он подробно аргументирует свою неприязнь, но я не стал вникать. Может, кому интересно.