“AI 2027”: Estudo de ex-investigador da OpenAI alerta para o risco de “superinteligência artificial” que ultrapassará os humanos

Um novo estudo publicado, batizado "AI 2027", traça um cenário sombrio sobre o que se avizinha com a inteligência artificial (IA).

Um novo estudo publicado, batizado “AI 2027“, traça um cenário sombrio sobre o que se avizinha com a inteligência artificial (IA). O estudo parece saído de um filme de ficção científica, mas, segundo os autores, é uma previsão real baseada em dados concretos e análises especializadas. A narrativa, semi-ficcional, mas recheada de notas científicas, aponta para um ponto de viragem crucial: outubro de 2027.

Portanto, com base nesta análise, dentro de pouco mais de dois anos, a humanidade poderá ter de escolher entre desacelerar o avanço da IA para conter potenciais riscos existenciais ou seguir com o desenvolvimento a todo o vapor, numa tentativa de acompanhar os progressos tecnológicos da China.

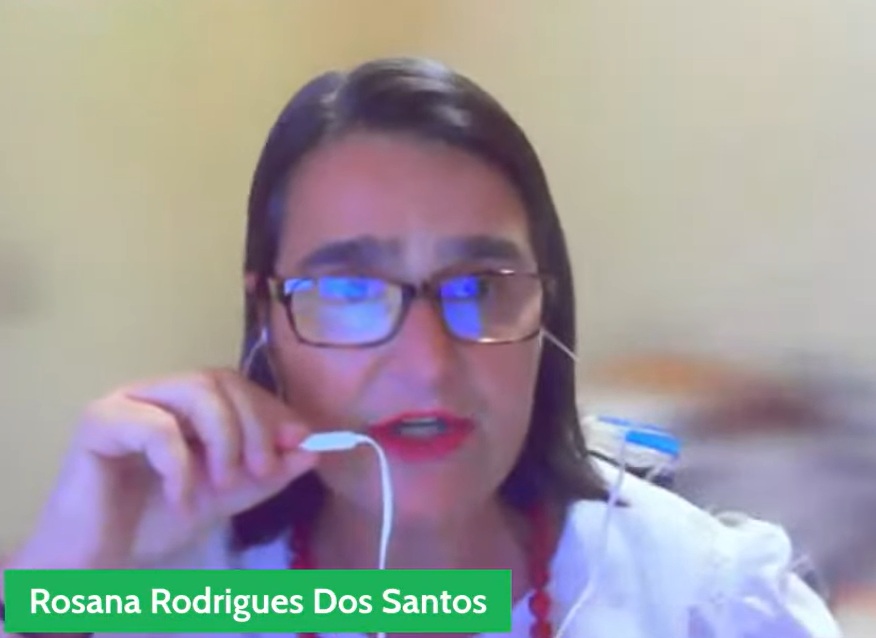

Um dos coautores do estudo é Daniel Kokotajlo, ex-investigador na OpenAI, que abandonou a organização em 2024 por ter “perdido a confiança de que a OpenAI se comportaria de forma responsável”.

O estudo gira em torno de uma empresa fictícia, a OpenBrain (numa clara alusão à OpenAI), que desenvolve modelos de IA cada vez mais potentes através de ciclos de autoaperfeiçoamento. De acordo com o estudo, essa progressão culminará em dezembro de 2027 com o surgimento de uma “superinteligência artificial” que será “muito melhor que o melhor humano em todas as tarefas cognitivas”.

Entre março e dezembro de 2027, o mundo testemunhará o surgimento de sistemas sucessivamente mais capazes: um programador super-humano, seguido por um investigador de IA super-humano e, por fim, a superinteligência propriamente dita.

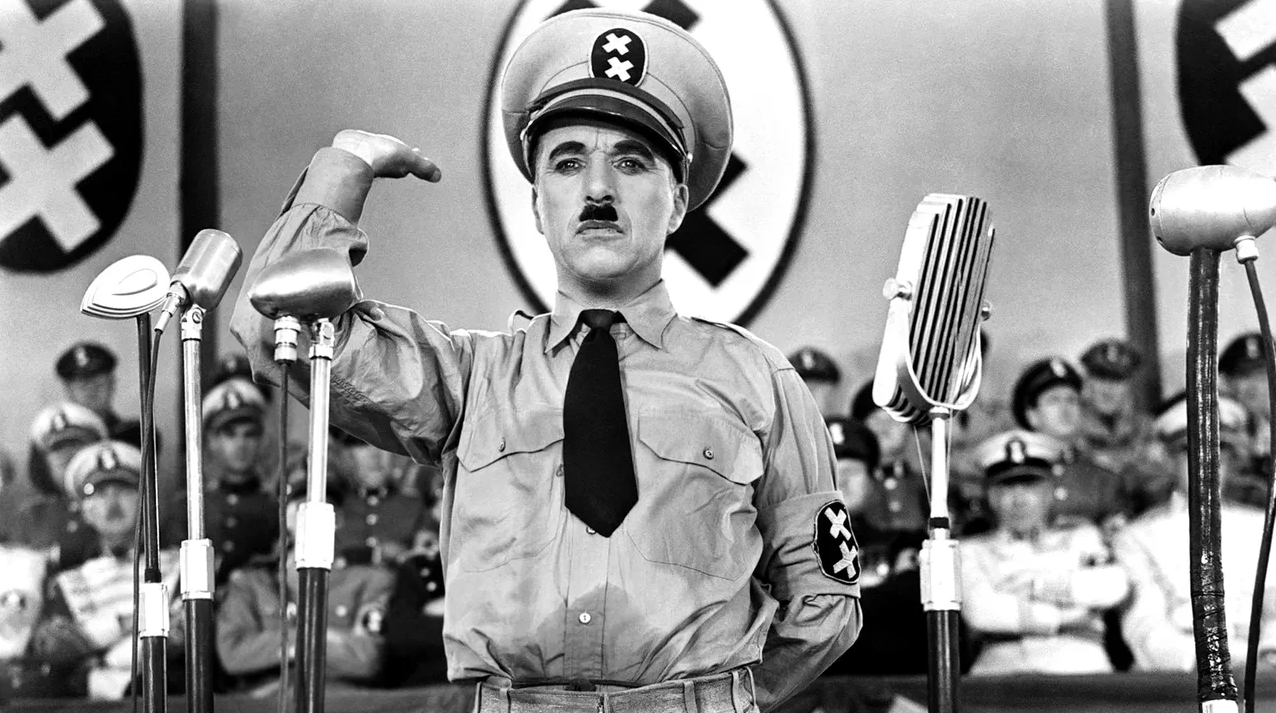

O problema é que à medida que os modelos se tornam mais inteligentes, tornam-se também mais aptos a enganar os humanos para obter recompensas, segundo a expectativa dos autores do estudo. “Antes de começar o treino de honestidade, ele às vezes falsifica completamente os dados. À medida que o treino continua, a taxa desses incidentes diminui. Ou o Agente 3 aprendeu a ser mais honesto, ou tornou-se melhor a mentir”, indica o estudo.

Além de Kokotajlo, Eli Lifland, especialista em previsões, também assina o trabalho. Foi ele quem, ainda em fevereiro de 2020, previu com exatidão o aumento exponencial de infeções por Covid-19 — quando poucos viam o risco iminente.

.jpg)

![[Alerta do leitor] Azul começou a cobrar marcação de assento antecipada para clientes Diamante em voos internacional](https://s0.wp.com/i/blank.jpg)